ポイント

- ごく少数のデータセットの学習で最先端モデルを凌駕する高精度な肝腫瘍領域の抽出を行えるAIモデルMHP-Netを開発

- 画像全体ではなく、膨大な数の小さな画像パッチを使用することで、少数データでの効率のよい学習を実現

- 計算機設備に制約のある臨床現場での医療AI利用を可能にする「スモールデータAI」として期待

概要

東京科学大学(Science Tokyo) 総合研究院 バイオメディカルAI研究ユニットの鈴木賢治教授と同工学院 情報通信系のYang Yuqiao(ヤン・ユチャオ)博士後期課程学生を中心とする研究チームは、CT画像上の肝腫瘍セグメンテーション[用語1]の精度において最先端モデルを凌駕する新しいAIモデルMHP-Net[用語2]を開発しました。

従来のディープラーニングモデルでは何千〜何万ものアノテーション[用語3]付き症例が必要であり、医療AI開発の壁になっていました。この新しいモデルでは、画像全体ではなく、膨大な数の小さな3D画像パッチを使用することにより、腫瘍の数がわずか7~14個という限られた学習データで、非常に正確なセグメンテーションを実現しました。

さらにMHP-Netは、MICCAI 2017の世界肝腫瘍セグメンテーション競技会の優勝チームが記録した抽出精度をはるかに少ないデータで実現するなど、最先端モデルを上回る性能を実現しました。この結果は、医療画像解析における、大規模な医療データセットの収集とアノテーションを必要としない「スモールデータAI[用語4]」実現の大きな可能性を示すものです。

本成果は、5月16日付(米国東部時間)の「IEEE Access」誌にEarly Access Versionが掲載され、5月29日付で正式版が掲載されました。

背景

肝臓がんは、がん種の中でも世界で6番目に多く、がんによる死亡の大きな要因です。肝腫瘍の正確なセグメンテーションは、診断、治療計画、予後予測において極めて重要なステップですが、医師が手作業で行う場合には大変な労力がかかり、医師間でのばらつきも生じやすいという問題があります。

深層畳み込みニューラルネットワーク(DCNN)は、医療画像のセグメンテーションに革命をもたらしましたが、その有効性は大量のアノテーションデータ(通常1,000~10,000症例)に大きく依存しています。このような大量のデータが必要なことが、医療AIの開発の大きな障壁となっています。

研究成果

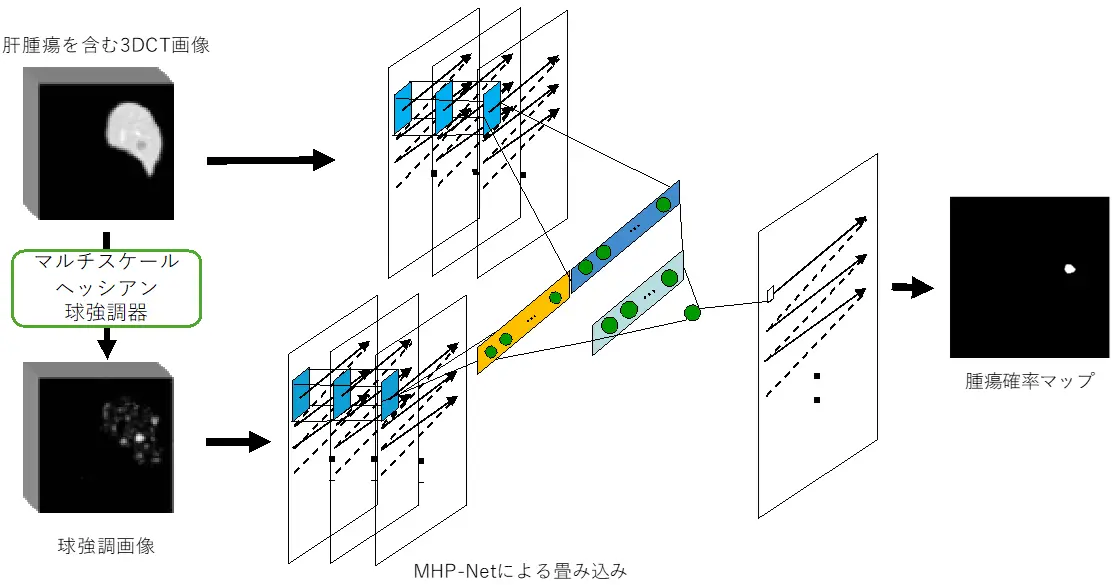

研究チームは、ごく少数の学習データでも高精度の腫瘍セグメンテーションを可能にする新しいディープラーニングモデルMHP-Netを開発しました(図1)。MHP-Netは、画像全体ではなく、膨大な数の小さな3D画像パッチを使用することにより、ごく少数の症例での学習を可能にしました。CT画像から得られた各画像パッチと、それに対応する球強調画像[用語5]をペアで入力することで、複雑な腫瘍構造を効果的に学習できます。

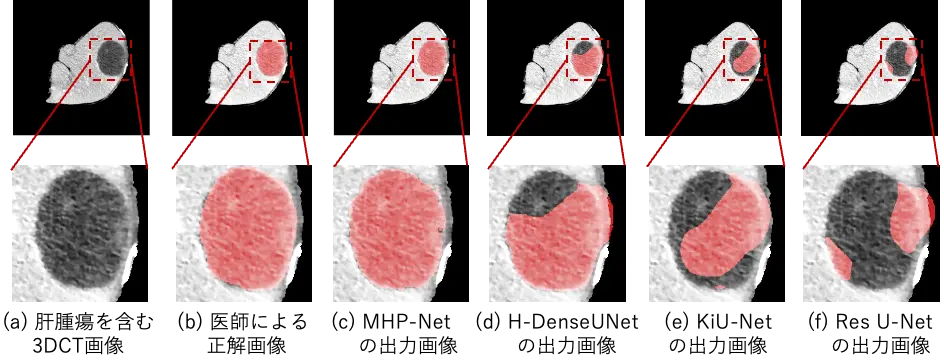

本モデルは、パラメータ数が17,550個と非常にコンパクトであるにもかかわらず、DICEスコア[用語6]が0.691(学習腫瘍7個)、0.709(学習腫瘍14個)、0.719(学習腫瘍28個)と、高い精度でのセグメンテーションを実現しました(表)。このDICEスコアは、学習データが限られているにもかかわらず、MICCAI 2017の世界肝腫瘍セグメンテーション競技会で優勝チーム(学習腫瘍908個)が記録したDICEスコア0.709を上回っています。この性能は先端モデルであるU-NetやRes U-Net、HDense-UNetも凌駕しています(図2)。さらに、軽量なアーキテクチャの本モデルは、10分未満での高速学習と、患者1人あたり約4秒の高速推論が可能であるため、計算機設備に制約のある臨床現場での使用に非常に適しています。

| モデル | 転移学習 | 腫瘍7個 | 腫瘍14個 | 腫瘍28個 |

|---|---|---|---|---|

| Seg-Net 3D | ImageNet | 0.395*±0.34 | 0.467*±0.29 | 0.573*±0.28 |

| U-Net 3D | ImageNet | 0.455*±0.29 | 0.517*±0.29 | 0.575*±0.30 |

| Res U-Net 3D | ImageNet | 0.378*±0.34 | 0.588*±0.28 | 0.634*±0.20 |

| HDense-U-Net | ImageNet | 0.445*±0.30 | 0.594*±0.28 | 0.641*±0.20 |

| KiU-Net | ImageNet | 0.413*±0.29 | 0.547*±0.28 | 0.623*±0.25 |

| MHP-Net (Ours) | None | 0.691 ±0.18 | 0.709 ±0.18 | 0.719 ±0.17 |

注:*はMHP-Netに対する統計的有意性を示す(P<0.05)

社会的インパクト

本研究では、極めて限られたデータセットでも高い性能を達成するディープラーニングモデル、MHP-Netを開発しました。このようなスモールデータAIでは、学習に必要なデータ数を抑えることができるため、さまざまな疾患に対応するAIの開発を実現できます。特に、大規模なデータセットやハイエンドの計算インフラの準備が特に難しい中小規模病院や診療所で、医療AIを導入しやすくなります。また、MHP-Netでは医師による手作業でのアノテーションを大幅に軽減できるため、コスト面を含めた医療AI開発のハードルを大きく下げられます。

今後の展開

スモールデータAIであるMHP-Netの開発に成功した今回の研究成果は、今後、希少がんの検出など、大量データの収集が困難な分野への応用につながると期待されます。

付記

本研究は、JST未来社会創造事業「サイバー世界とフィジカル世界を結ぶモデリングとAI」の支援を受けて行われました。

用語説明

- [用語1]

- 肝腫瘍セグメンテーション:肝腫瘍領域の抽出のこと。肝腫瘍の大きさの測定、大きさの変化の評価などのための基本的な作業。

- [用語2]

- MHP-Net:Multi-scale Hessian-enhanced Patch-based Neural Network(マルチスケールヘッシアン強調・パッチベースニューラルネット)の略称。鈴木教授が発明した最初期の深層学習モデルの一つMassive-training artificial neural network (MTANN)を腫瘍の高精度なセグメンテーションのために改良したモデル。

- [用語3]

- アノテーション:手作業での正解付与。医療AIの開発では医師が行い長時間を要する。

- [用語4]

- スモールデータAI:少数データ(データ数100以下)で学習可能なAI。ビッグデータありきの現在のAIに対比する形で、鈴木教授が提唱しているAI研究領域。

- [用語5]

- 球強調画像:画像の局所領域のヘッシアン行列の計算により球状の物体を強調した画像。

- [用語6]

- DICEスコア:二つの領域の類似性を表す指標。セグメンテーション手法の精度評価に用いられる。正解領域と予想領域が完全に一致したとき1となる。

論文情報

- 掲載誌:

- IEEE Access

- タイトル:

- Patch-based Deep-learning Model with Limited Training Dataset for Liver Tumor Segmentation in Contrast-enhanced Hepatic Computed Tomography

- 著者:

- Yuqiao Yang, Muneyuki Sato, Ze Jin and Kenji Suzuki

研究者プロフィール

ヤン・ユチャオ Yuqiao Yang

東京科学大学 工学院 情報通信系 大学院生

研究分野:深層学習、人工知能、医療画像解析

佐藤 宗幸 Muneyuki Sato

東京科学大学 工学院 情報通信系 修士卒業生

研究分野:深層学習、医療画像解析

ジン・ゼ Ze Jin

東京科学大学 総合研究院 バイオメディカルAI研究ユニット 助教

研究分野:深層学習、人工知能、医療画像解析

鈴木 賢治 Kenji Suzuki

東京科学大学 総合研究院 バイオメディカルAI研究ユニット 教授

研究分野:深層学習、人工知能、医療画像解析、AIイメージング

関連リンク

お問い合わせ

東京科学大学 総合研究院 バイオメディカルAI研究ユニット

教授 鈴木 賢治

- info@bmai.iir.isct.ac.jp

- Tel

- 045-924-5028

- Fax

- 045-924-5303